"الذكاء الاصطناعي قد يقتل الناس مستقبلاً"!

توضيحية

توضيحية

حذر المدير التنفيذي السابق لشركة "غوغل" ورائد الذكاء الاصطناعي، مصطفى سليمان، من إمكانية استخدام الذكاء الاصطناعي لخلق وباء مميت. وفي حديثه في حلقة من البودكاست The Diary of a CEO، قال سليمان إنه يمكن استخدام الذكاء الاصطناعي لتصميم فيروسات أو بكتيريا جديدة أكثر فتكا ومقاومة للعلاج.

وأشار سليمان إلى أن هذه الفيروسات يمكن أن "تنتشر بشكل أسرع أو ان تكون أكثر فتكا"، مما يسبب في النهاية "المزيد من الضرر" وربما يقتل الناس "مثل الوباء". وقال: "نحن نعمل مع أشياء خطيرة، لا يمكننا السماح لأي شخص بالوصول إليها. إننا بحاجة إلى تحديد من يمكنه استخدام برامج الذكاء الاصطناعي، والأنظمة السحابية، وحتى بعض المواد البيولوجية".

ومصطفى سليمان هو باحث ورجل أعمال بريطاني في مجال الذكاء الاصطناعي. وهو أيضا المؤسس المشارك والرئيس السابق للذكاء الاصطناعي التطبيقي في DeepMind، وهي شركة ذكاء اصطناعي استحوذت عليها "غوغل".

ولا يعد سليمان الوحيد الذي يشعر بالقلق إزاء المخاطر المحتملة للذكاء الاصطناعي. حيث كشف عدد من الخبراء في هذا المجال عن مخاوفهم بشأن الاستخدام السيئ لمثل هذه التكنولوجيا، وحذروا من إمكانية استخدام الذكاء الاصطناعي لصنع أسلحة بيولوجية.

وفي آذار الماضي، حذر باحثون من إمكانية إعادة استخدام الذكاء الاصطناعي لصنع أسلحة كيميائية حيوية جديدة. وقالوا إن تجربتهم يجب أن تكون بمثابة "جرس تنبيه" لأولئك الذين يستخدمون تقنيات الذكاء الاصطناعي لاكتشاف الأدوية. وحتى الشركات التي ابتكرت تقنيات الذكاء الاصطناعي هذه اعترفت بالضرر المحتمل الذي قد تسببه.

ووقع الرؤساء التنفيذيون لشركة OpenAI وGoogle DeepMind وStability AI، في شهر آذار، على بيان يدعو إلى جعل التخفيف من "خطر الانقراض الناجم عن الذكاء الاصطناعي" أولوية عالمية.

وكان الدكتور جيفري هينتون، الذي يُنظر إليه على نطاق واسع على أنه "الأب الروحي للذكاء الاصطناعي" والذي استقال مؤخرا من "غوغل" بعد التحذير من مخاطر التكنولوجيا، من بين الموقعين البارزين على هذا البيان. وجاء في البيان القصير الذي نشره مركز سلامة الذكاء الاصطناعي: "يجب أن يكون التخفيف من خطر الانقراض الناجم عن الذكاء الاصطناعي أولوية عالمية إلى جانب المخاطر المجتمعية الأخرى مثل الأوبئة والحرب النووية".

وقد تم التوقيع على البيان من قبل أكثر من 300 باحث ومهندس وأكاديمي ومتخصص في مجال التكنولوجيا في مجال الذكاء الاصطناعي.

bar_chart_4_bars اقتصاد واستهلاك

ارتفاع أسعار النفط مع ترقب التجار لأحداث...

2024/10/10 18:21

إيكونوميست: وتيرة فرار الأموال من إسرائيل...

2024/09/26 07:36

ارتفاع معدل التضخّم في إسرائيل - البندورة...

2024/09/16 08:27

إلغاء الاستثمارات في نصف شركات الهايتك...

2024/09/12 14:08bar_chart_4_bars Chefcom - شيفكم

فلافل الشمندر.. ابتكار شهيّ وغنيّ

2024/09/10 14:08

الحامض بالنعناع - عصير الصيف المنعش

2024/07/22 00:12

حلوى عيش السرايا.. سهلة وبسيطة

2024/07/18 20:48

سلطة التين المشوي مع الجرجير

2024/07/01 00:08bar_chart_4_bars فن وناس

القبض على سعد الصغير وبحوزته مواد مخدرة في...

2024/09/10 13:52

الفنانة رانيا منصور تستعيد رشاقتها بعد...

2024/08/27 09:50

اعتداء جنسي؟ إقصاء زوج هبة طوجي من لجنة...

2024/08/26 15:54

يبدأ عرضه اليوم: 4 أسباب تحمسك لمشاهدة...

2024/08/18 03:12bar_chart_4_bars مقالات متعلقة

السعودية: تنفيذ حكم القتل في مواطن أدين...

2024/10/11 11:15

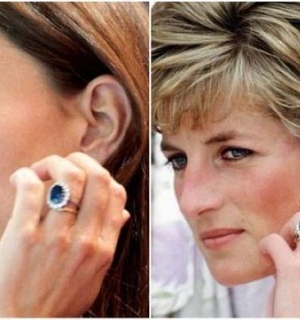

قصة خاتم خطوبة كيت ميدلتون المتوارث عن...

2024/09/02 17:51

خطر حقيقي يهدد مدينة روما!

2024/08/20 01:14

سعودي يتجول مع عادل إمام في روسيا (صورة)

2024/08/12 15:39

انفجار هائل يؤدي لظهور كرة نار على سفينة...

2024/08/09 15:39